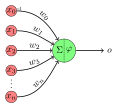

| DescriciónPerceptron-unit.svg |

English: An artificial neuron. It has input nodes  , weights  . The input signals get multiplied with the weights. The results are summed up. Then the activation function  is applied (e.g. sigmoid, tanh, ReLU, ...). This is then the output  of the artificial neuron. Overall, the perceptron unit is a function  . Typical choices for activation functions  are the sigmoid function  or ReLU  .

The input  is called the bias and is constant 1, so is called the bias and is constant 1, so  . .

Deutsch: Ein künstliches Neuron. Es hat Eingabeknoten  , Gewichte  . Die Eingabesignale werden jeweils mit den Gewichten multipliziert. Die Ergebnisse werden aufsummiert. Dann wird auf die Summe die Aktiviertungsfunktion  (z.B. die Sigmoid-Funktion, tanh, ReLU, ...) angewendet. Die Perzeptron-Einheit beschreibt also eine Funktion  . Zwei typische Aktivierungsfunktionen  sind die Sigmoidfunktion  und ReLU  .

Der Eingabeknoten  wird Bias genannt und ist konstant 1, also wird Bias genannt und ist konstant 1, also  . .

|